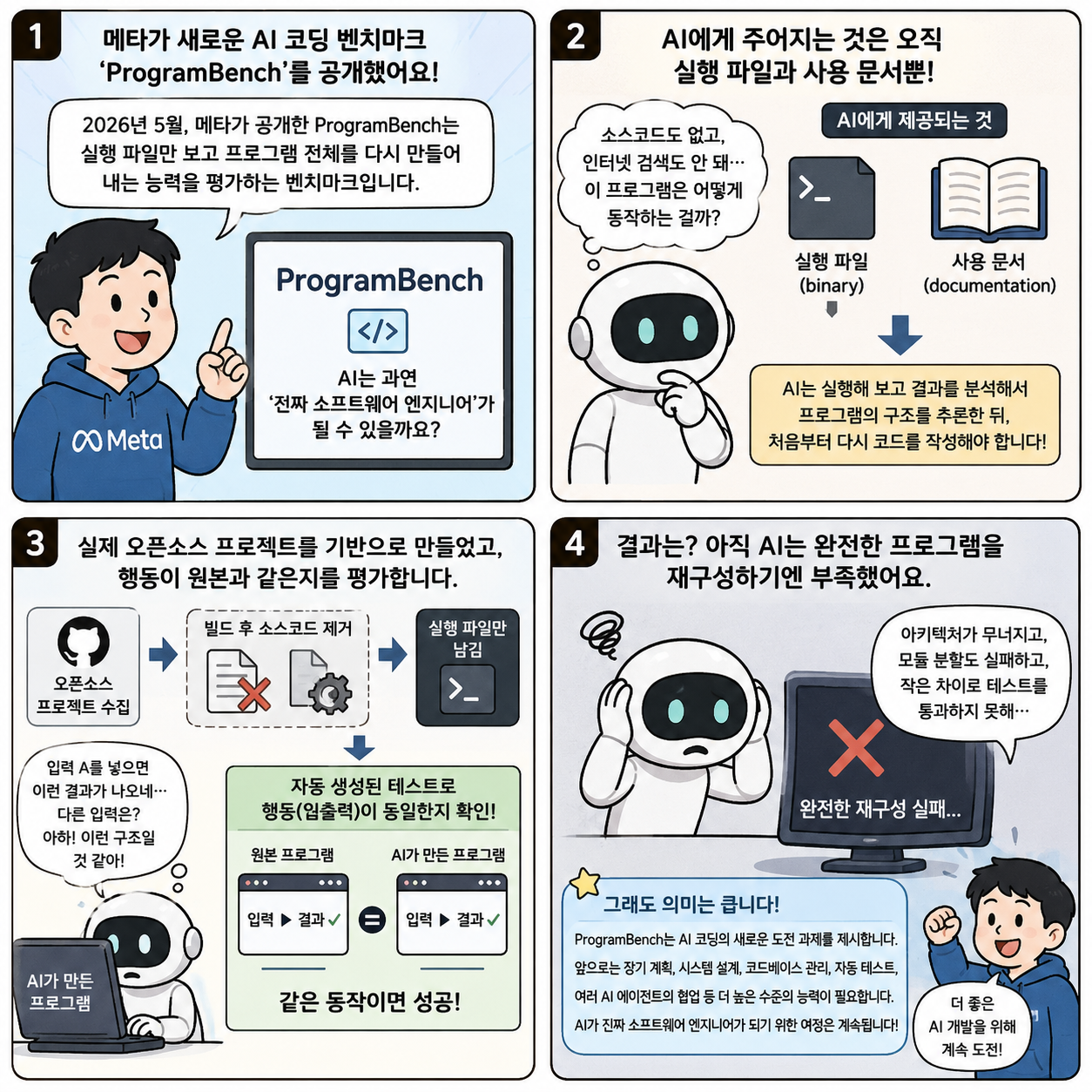

메타(Meta)는 2026년 5월, 스탠퍼드대와 하버드대 연구진과 함께 새로운 AI 코딩 벤치마크인 ProgramBench를 공개했습니다. 이 벤치마크는 단순히 “코드를 얼마나 잘 작성하는가”를 평가하는 수준을 넘어, AI가 실제 소프트웨어를 얼마나 깊이 이해하고 재구성할 수 있는지를 측정하기 위해 만들어졌습니다. 특히 기존의 소스코드를 전혀 제공하지 않은 상태에서 실행 프로그램만 보고 다시 프로그램을 만들어야 한다는 점에서 큰 주목을 받았습니다. 현재의 생성형 AI가 코드 자동완성 단계는 상당 부분 넘어섰지만, 여전히 “진짜 소프트웨어 엔지니어” 수준에는 도달하지 못했다는 사실을 보여준 사례로 평가받고 있습니다.

실행 파일만으로 전체 프로그램을 재구성

ProgramBench는 기존 코딩 벤치마크와 접근 방식 자체가 다릅니다. 일반적인 프로그래밍 평가에서는 이미 존재하는 코드 일부를 수정하거나, 함수 하나를 작성하거나, 버그를 해결하는 문제가 주어지는 경우가 많습니다. 하지만 ProgramBench에서는 AI에게 오직 컴파일된 실행 파일과 프로그램 사용 문서만 제공됩니다. 원본 소스코드도 없고 인터넷 검색도 제한됩니다. AI는 프로그램이 어떻게 동작하는지를 관찰한 뒤, 내부 구조를 추론하고 전체 코드를 새롭게 작성해야 합니다.

예를 들어 AI는 실행 파일을 직접 실행해 보면서 어떤 입력을 넣었을 때 어떤 출력이 나오는지를 분석합니다. 그리고 그 결과를 바탕으로 프로그램의 내부 로직과 구조를 추정해야 합니다. 단순히 코드 몇 줄을 생성하는 것이 아니라, 프로그램 전체의 구조를 설계하고 여러 파일로 구성된 코드베이스를 만들며, 컴파일 시스템까지 다시 구현해야 하는 것입니다. 이는 사람 개발자에게도 상당히 어려운 작업입니다.

메타 연구진은 이러한 문제를 통해 AI의 “장기적 소프트웨어 설계 능력”을 평가하려 했다고 설명합니다. 현재의 대형 언어모델은 짧은 코드 생성이나 부분적인 수정에는 강점을 보이지만, 대규모 시스템을 처음부터 설계하고 유지하는 능력은 아직 충분히 검증되지 않았다는 것입니다. 실제 개발 환경에서는 단순히 문법적으로 맞는 코드를 쓰는 것보다, 시스템을 논리적으로 분해하고 모듈화하며 유지보수 가능한 구조를 만드는 능력이 훨씬 중요합니다. ProgramBench는 바로 이런 능력을 측정하려는 시도라고 볼 수 있습니다.

벤치마크에 포함된 과제들은 실제 오픈소스 프로젝트를 기반으로 제작되었습니다. 연구진은 GitHub의 공개 저장소에서 C, C++, Go, Rust, Java 같은 컴파일 언어 기반 프로젝트를 수집한 뒤, 프로그램을 먼저 빌드하고 실행 파일만 남긴 상태에서 모든 소스코드를 제거했습니다. 이후 AI는 실행 프로그램의 동작만 관찰하면서 원래 프로그램과 비슷하게 동작하는 새로운 코드를 작성해야 했습니다.

실제로 동일하게 동작하는가? 거의 모든 모델이 0점

평가 방식도 흥미롭습니다. 단순히 코드가 비슷하게 생겼는지를 보는 것이 아니라, 실제로 동일하게 동작하는지를 검증합니다. 연구진은 원본 프로그램에 다양한 입력을 넣어 자동으로 테스트를 생성했고, AI가 만든 프로그램이 동일한 결과를 출력하는지를 확인했습니다. 즉 중요한 것은 코드 스타일이 아니라 “행동 수준에서 같은 프로그램인가”라는 점입니다.

ProgramBench가 큰 화제를 모은 이유 중 하나는 최신 AI 모델들의 성능이 예상보다 매우 낮았기 때문입니다. 공개된 결과에 따르면 현재의 최첨단 모델들조차 전체 과제를 완벽히 해결하지 못했습니다. 일부에서는 “모든 모델이 사실상 0점에 가까운 결과를 기록했다”는 표현까지 나왔습니다. 물론 세부적으로 보면 일부 기능은 상당 수준 복원해냈지만, 완전한 시스템 수준 재구성에는 실패했다는 의미입니다.

이 결과는 현재 AI 코딩 기술의 한계를 비교적 명확하게 보여줍니다. 오늘날 AI는 짧은 코드 작성이나 API 사용, 간단한 애플리케이션 생성에는 상당히 뛰어난 모습을 보입니다. 하지만 대규모 시스템을 장기적으로 설계하고, 여러 구성 요소를 유기적으로 연결하며, 복잡한 소프트웨어 구조를 안정적으로 유지하는 능력은 아직 부족하다는 것입니다. 특히 긴 작업 과정에서 잘못된 가정을 누적하거나 구조 설계가 무너지면서 전체 시스템 품질이 급격히 떨어지는 현상이 관찰됐습니다.

그럼에도 불구하고 ProgramBench는 매우 중요한 의미를 가집니다. 지금까지의 AI 코딩 평가는 대부분 “부분 문제 해결” 중심이었습니다. 그러나 실제 소프트웨어 개발은 훨씬 더 장기적이고 구조적인 작업입니다. 따라서 앞으로 AI 연구는 단순 코드 생성보다도 시스템 설계, 장기 계획, 코드베이스 관리, 자동 테스트, 여러 에이전트 간 협업 같은 방향으로 이동할 가능성이 큽니다. ProgramBench는 이런 흐름을 상징적으로 보여주는 벤치마크라고 할 수 있습니다.